Die Mensch-Maschine-Einheit: Von der Weird Machine zum Weird Sociotechnical System

Maximale Schadensszenarien entstehen in heute üblichen Angriffen, z. B. mit Ransomware oder CEO-Fraud, durch die Kombination von Software-Exploits, Social Engineering und Kenntnissen über interne Organisationsabläufe. Technik, Mensch und Organisation werden so von Angreifern als Mensch-Maschine-Einheit bedroht, während sich die Bewertung von Risiken für die Informationssicherheit häufig auf technische Schwachstellen fokussiert.

Sebastian Klipper

CycleSEC Geschäftsführer

In seinem aktuellen Beitrag in der wissenschaftlichen Fachzeitschrift HMD Praxis der Wirtschaftsinformatik hat der CycleSEC Gründer und Geschäftsführer Sebastian Klipper sich damit befasst, wie Menschen, Maschinen und Organisationen angegriffen werden, um die Sicherheit der soziotechnischen Systeme zu kompromitieren, in die sie eingebettet sind [1]. Auch hier im Blog wollen wir das Thema näher beleuchten.

Faktor Mensch zu wenig berücksichtigt

Sebastian Klipper erläutert in seinem Beitrag, dass IT-Systeme durch Angriffe auf technische Schwachstellen kompromittiert werden und Social Engineers menschliche Schwachpunkte zum Ziel haben. Die Kombination von Software-Exploits, Social Engineering und Kenntnissen über interne Organisationsabläufe führt in heute üblichen Angriffen zu maximalen Schadensszenarien. Bedroht ist nicht das einzelne IT-System oder einzelne Menschen, sondern die Kombination aus Technik, Mensch und Organisation. Die Bewertung von Risiken für die Informationssicherheit fokussiert allerdings häufig noch auf technische Schwachstellen.

Während man im Bereich der IT-Sicherheit mit dem Konzept Assume Breach längst anerkennt, das technische Systeme im Laufe der Zeit durch Schwachstellen kompromittiert werden, wird fehlerbehaftetes menschliches Verhalten weiterhin zu selten berücksichtigt.

Sebastian Klipper

CycleSEC Geschäftsführer und u.a. Co-Autor des 2017 vom DIN herausgegebenen Buchs Managementsysteme für Informationssicherheit (ISMS) mit DIN EN ISO/IEC 27001 betreiben und verbessern [5].

Wenn man dieser Entwicklung im Management von Risiken der Informations- und IT-Sicherheit etwas entgegensetzen will, „müssen Sicherheitsmaßnahmen die Einbettung technischer Lösungen in soziotechnische Systeme deutlich stärker berücksichtigen, als das heute üblich ist“, fordert Klipper in seinem Beitrag. Hierzu gehören seiner Einschätzung nach einerseits umfassendere Szenarioanalysen im Risikoassessment. Anderseits gehört auch eine stärkere Berücksichtigung des Faktors Mensch dazu. Das gilt insbesondere bei Design, Test und Implementierung von IT-Systemen, die als Teil soziotechnischer Systeme verstanden werden müssen.

Die Mensch-Maschine-Einheit: Von der Weird Machine zum Weird Sociotechnical System

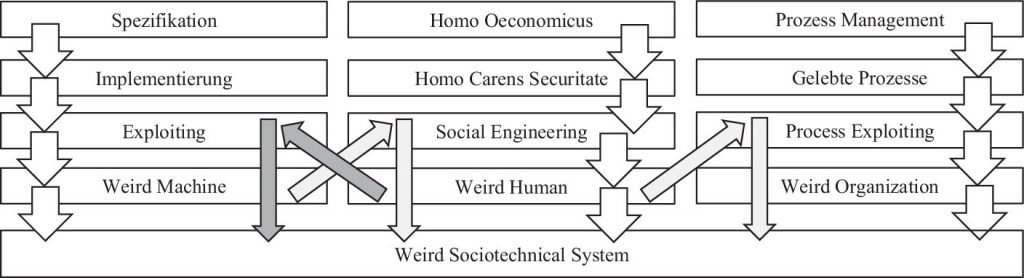

Der Beitrag betrachtet den Faktor Mensch in der Informationssicherheit ausgehend von dem Model der Weird Machine nach Bratus e.a. [2]. Als Weird Machine bezeichnet man demnach ein Computerprogramm, das zusätzlichen Code (Exploit) ausführt, was so in seiner ursprünglichen Anforderungsbeschreibung nicht gewünscht war. Er ergänzt die Modelle des Weird Humans und der Weird Organization und kombiniert sie zu einem Angriffsmodell auf die Mensch-Maschine-Einheit, wie sie Rophol [3] beschrieben hat:

Ein Computer wird erst wirklicher Computer, wenn er zum Teil einer MenschMaschine-Einheit geworden ist. Wenn Text geschrieben wird, tut das nicht allein der Mensch, aber es ist auch nicht allein der Computer, der den Text schreibt. Erst die Arbeitseinheit von Mensch und Computer bringt die Textverarbeitung zuwege. Da freilich im benutzten Computer immer schon die Arbeit anderer Menschen verkörpert ist, (…) bezeichne ich sie als soziotechnisches System.

Günter Ropohl

Allgemeine Technologie [3]

IT-Systeme und Menschen sind also Bestandteile soziotechnischer Systeme. Bei der Betrachtung der technischen Sicherheitsaspekte muss man sich dieser Einbettung stets bewusst sein.

Der Weg zum Weird Sociotechnical System kann laut Klipper „in der Realwelt jeweils direkt über Weird Machine und Weird Human beschritten werden, oder diese sind jeweils der Einstiegspunkt in die Exploit-Programmierung bzw. umgekehrt ins Social Engineering.“ Das Geschäftsmodell eines Angreifers ergibt sich seiner Beschreibung nach jeweils durch die Einbettung in eine Organisation und ihre Prozesse.

Beispiel E-Mail

Beispielhaft erörtert Sebastian Klipper dies anhand der E-Mail-Verschlüsselung. Seiner Ansicht nach sei diese in real existierenden soziotechnischen Systemen seit Jahren als inhärent gescheitert zu betrachten, weil sie schlicht keine ausreichende Anwendung finde. Ein mathematischer Sicherheitsbeweis für die in PGP oder S/MIME genutzten Verschlüsselungsverfahren sei wenig hilfreich, wenn diese in der Realität nicht genutzt würden und ihre Anwendung bei den kommunizierenden Personen unbekannt oder diesen zu aufwändig seien:

Die Feststellung, dass ein technisches Verfahren unter Laborbedingungen und nach Definition zahlreicher Ceterus-Paribus-Klauseln sicher ist, hat nur begrenzten Wert, wenn diese Feststellung einer Überprüfung in einem soziotechnischen System der Realwelt aufgrund unzureichender Akzeptanz nicht standhält.

Sebastian Klipper

CycleSEC Geschäftsführer

Menschliches Fehlverhalten einplanen

Als Lösungsansatz fordert Sebastian Klipper die stärkere Berücksichtigung von fehlerbehaftetem menschlichen Verhalten bei der Gestaltung von Sicherheitsrichtlinien oder bei der Implementierung von sicherheitsrelevanten Technologien. Design-Paradigmen wie fail safe und security bzw. privacy by design müssten nicht nur technische Fehler berücksichtigen.

Überall dort, wo man von sicherheitsbewusstem und fehlerfreiem menschlichen Verhalten abhängig sei, müsse man Testfälle berücksichtigt, die unsichere und fehlerbehaftete menschliche Handlungen beinhalteten:

Provoziert das System durch mangelnde Akzeptanz menschliches Fehlverhalten und was passiert nach menschlichen Fehlern?

Sebastian Klipper

CycleSEC Geschäftsführer

Insbesondere bei der Risikoidentifikation sollten Risiken ermittelt werden, die durch menschliches Fehlverhalten entstehen oder in der Risikobehandlung von Anforderungen an menschliches Verhalten abhängen. Die mangelnde Akzeptanz von Sicherheitsmaßnahmen darf im Risikomanagement nicht ausgeklammert werden. Gerade hier können Ihnen unsere CycleSEC-Consultants im Rahmen des Risikomanagementprozesses beratend und tatkräftig zu Seite stehen.

Mehr in unserem Blog

Quellen

[1] Sebastian Klipper, Weird Sociotechnical Systems Wie Menschen, Maschinen und Organisationen angegriffen werden, um die Sicherheit der soziotechnischen Systeme zu kompromitieren, in die sie eingebettet sind. HMD Praxis der Wirtschaftsinformatik, 2020

[2] Bratus S, Locasto ME, Patterson ML, Sassaman L, Shubina A (2016) Exploit programming from buffer overflows to “weird machines” and theory of computation. http://langsec.org/papers/Bratus.pdf, zugegriffen: 16. Febr. 2020

[3] Ropohl G (2009) AllgemeineTechnologie. https://www.ksp.kit.edu/site/books/m/10.5445/KSP/1000011529/ , zugegriffen: 16. Febr. 2020

[4] Sebastian Klipper, Information Security Risk Management. 2. überarbeitete Auflage, Springer Vieweg 2015, ISBN: 978-3-8348-1360-2

[5] Sebastian Klipper, Managementsysteme für Informationssicherheit (ISMS) mit DIN EN ISO/IEC 27001 betreiben und verbessern, Beuth 2017, ISBN: 978-3-410-26032-5

[6] Sebastian Klipper, Cyber Security: Ein Einblick für Wirtschaftswissenschaftler. Springer Vieweg 2015, ISBN: 978-3-658-11577-7